Conference45min

Docker Compose votre Dev Toolkit pour AI & Cloud

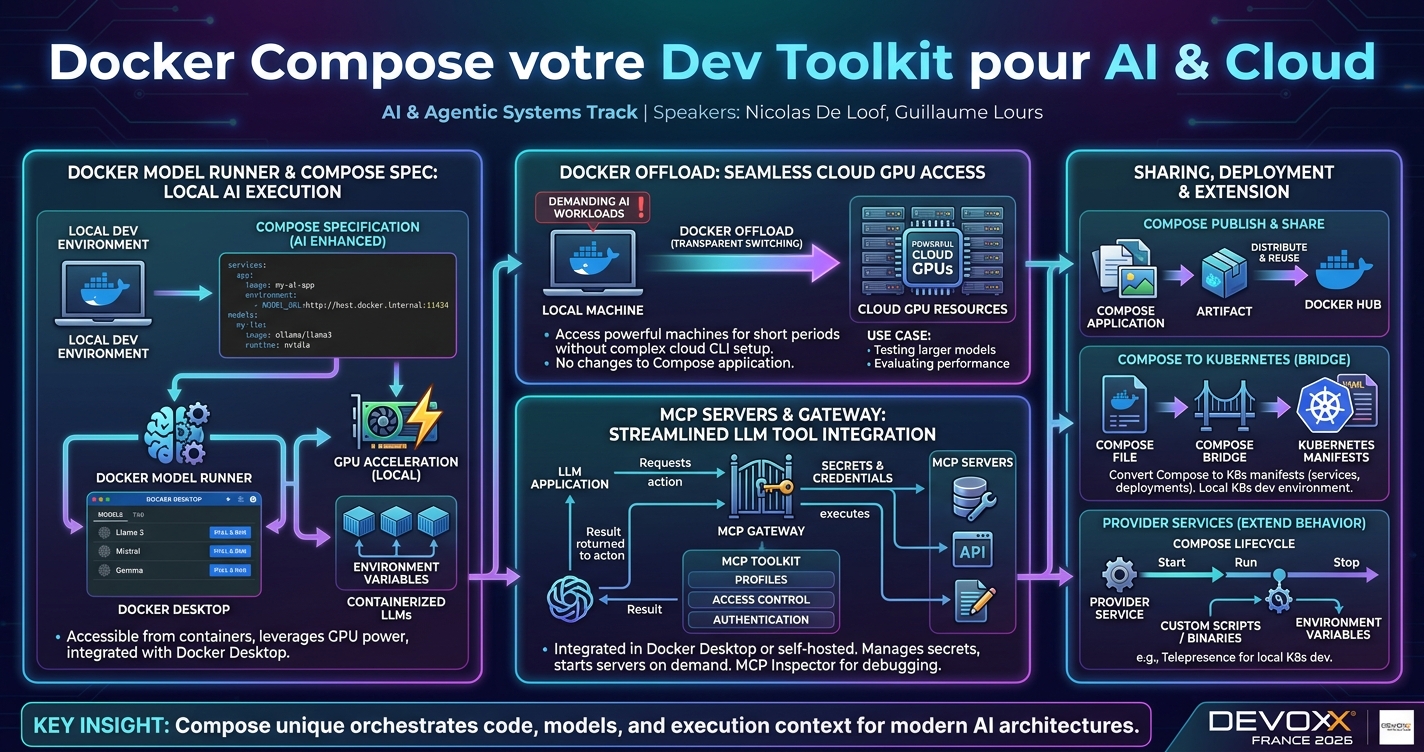

Cette session présente les nouveautés de Docker Compose pour orchestrer des applications basées sur des LLMs : définition de modèles via models, connexion à des ressources externes avec provider services et délestage GPU grâce à Docker Offload. Une démo montre comment unifier code, modèles et exécution pour les projets IA modernes.

talk.summaryAiDisclaimer

Nicolas De LoofDocker

Guillaume LoursDocker

talkDetail.whenAndWhere

Friday, April 24, 11:35-12:20

Paris 143

Docker Compose est un outil incontournable pour orchestrer des environnements de développement locaux. À l’ère de l’IA, il franchit encore une nouvelle étape.

Durant cette session, nous montrerons comment les dernières évolutions de Docker Compose permettent de définir de manière déclarative des applications basées sur des LLMs.

Nous verrons comment intégrer un modèle d’IA directement dans une application via la section

Durant cette session, nous montrerons comment les dernières évolutions de Docker Compose permettent de définir de manière déclarative des applications basées sur des LLMs.

Nous verrons comment intégrer un modèle d’IA directement dans une application via la section

models, comment se connecter à des ressources externes grâce aux provider services, et comment Docker Offload prend le relais lorsque les ressources de la machine locale ne suffisent plus.Au programme, en live :

- Définir un LLM dans un fichier Compose avec la clé

models - Accéder à ces modèles depuis les conteneurs applicatifs

- Utiliser les provider services pour préparer ou connecter des ressources externes

- Déporter des charges de travail lourdes (GPU) à distance avec Docker Offload

- Utiliser Compose unique pour orchestrer code, modèles et contexte d’exécution