Conference45min

Mesurer l’immesurable : Comment évaluer les systèmes à base d’IA générative ?

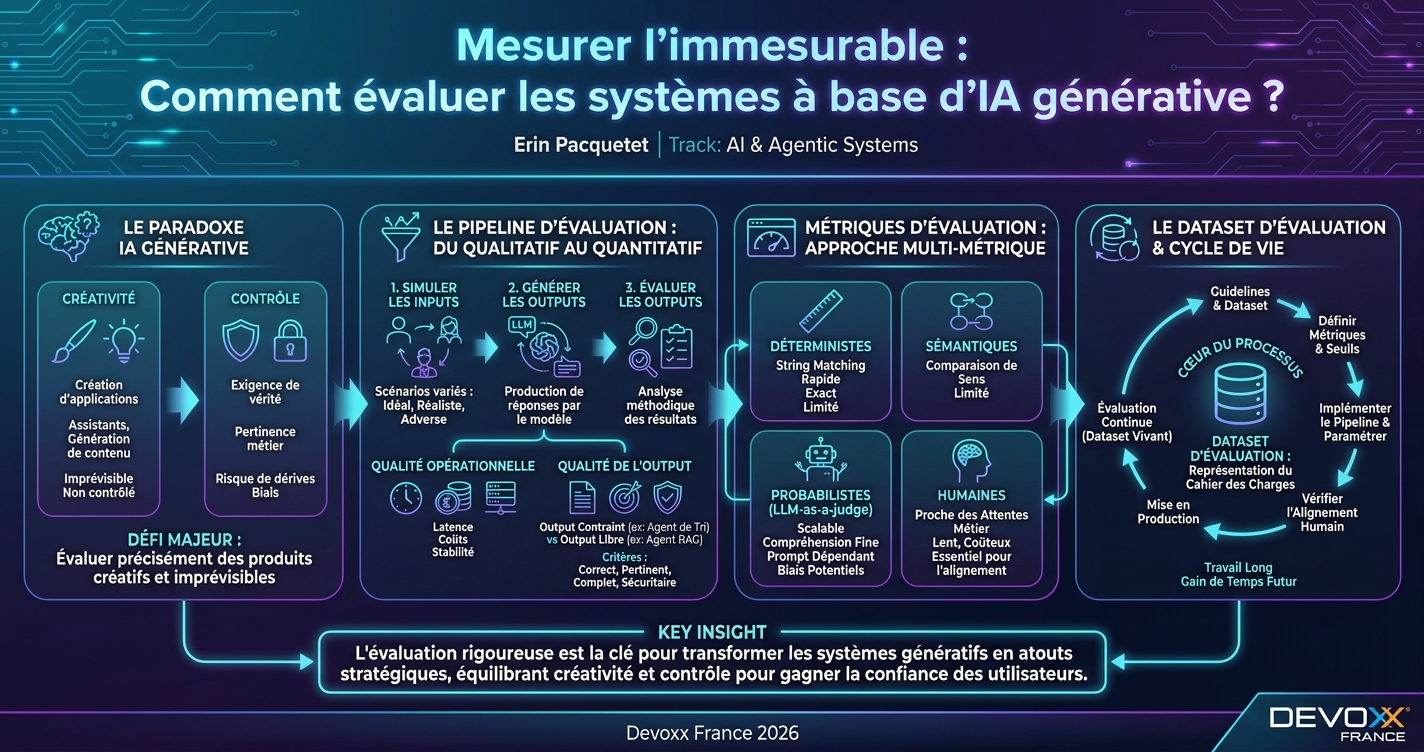

Cette session explore l’évaluation des applications d’IA générative, entre créativité et fiabilité. Elle présente les limites des métriques classiques, l’usage du “LLM-as-a-judge”, l’importance du jugement humain et du suivi continu. Un cas de chatbot RAG illustre un pipeline d’évaluation complet et reproductible.

talk.summaryAiDisclaimer

Erin PacquetetSCIAM

talkDetail.whenAndWhere

Wednesday, April 22, 10:30-11:15

Paris 143

Les IA génératives révolutionnent la création d’applications, ouvrant des usages variés : assistants, génération de contenu, recherche augmentée, et facilitant des tâches complexes. Mais un défi majeur subsiste : évaluer précisément des produits basés sur des modèles à la fois créatifs et imprévisibles.

Cette session explore ce paradoxe : exploiter les LLM tout en maîtrisant l’évaluation de leurs résultats. Nous verrons comment ajuster critères et méthodes pour évaluer exactitude technique, cohérence et pertinence métier. Au programme : limites des métriques classiques, évaluation automatisée via “LLM-as-a-judge” (et ses biais), importance de l’évaluation humaine, et suivi continu pour détecter dérives et effets secondaires.

Nous analyserons le cas d’un chatbot RAG, où créativité linguistique et exigence de vérité s’opposent. L’évaluation, équilibre de factualité et fluidité, contrôle la précision sans maîtriser la question posée. Ce cas concret nous servira de fil rouge pour voir comment implémenter un pipeline d'évaluation complet et reproductible.

Cette session offre des repères et outils pour évaluer méthodiquement les systèmes génératifs et en faire un atout stratégique en IA.

Cette session explore ce paradoxe : exploiter les LLM tout en maîtrisant l’évaluation de leurs résultats. Nous verrons comment ajuster critères et méthodes pour évaluer exactitude technique, cohérence et pertinence métier. Au programme : limites des métriques classiques, évaluation automatisée via “LLM-as-a-judge” (et ses biais), importance de l’évaluation humaine, et suivi continu pour détecter dérives et effets secondaires.

Nous analyserons le cas d’un chatbot RAG, où créativité linguistique et exigence de vérité s’opposent. L’évaluation, équilibre de factualité et fluidité, contrôle la précision sans maîtriser la question posée. Ce cas concret nous servira de fil rouge pour voir comment implémenter un pipeline d'évaluation complet et reproductible.

Cette session offre des repères et outils pour évaluer méthodiquement les systèmes génératifs et en faire un atout stratégique en IA.

Erin Pacquetet

Erin Pacquetet est data scientist senior chez SCIAM, où elle conçoit et industrialise des solutions d’IA autour du NLP, des LLM et des chatbots RAG pour des cas d’usage concrets en entreprise. Passionnée par le lien entre linguistique et informatique pour des solutions créatives aux problèmes réels, elle transforme avec expertise des problématiques produits en architectures IA robustes, évaluables et accessibles aux équipes dev comme aux métiers.

Elle possède une expertise approfondie couvrant la conception et optimisation de prompts, la gestion avancée des pipelines de données, l’évaluation rigoureuse des modèles, ainsi que l’intégration et la mise en production de solutions IA industrielles.

Parallèlement, elle reste active en recherche scientifique et en outreach, notamment sur des sujets comme l'analyse des modèles IA, l’intégration pragmatique de l’IA en dev, et l’interaction humain-machine via le langage, qu’elle partage régulièrement en meetups et conférences depuis plusieurs années.

Elle possède une expertise approfondie couvrant la conception et optimisation de prompts, la gestion avancée des pipelines de données, l’évaluation rigoureuse des modèles, ainsi que l’intégration et la mise en production de solutions IA industrielles.

Parallèlement, elle reste active en recherche scientifique et en outreach, notamment sur des sujets comme l'analyse des modèles IA, l’intégration pragmatique de l’IA en dev, et l’interaction humain-machine via le langage, qu’elle partage régulièrement en meetups et conférences depuis plusieurs années.