Conference45min

LLMs et Hallucinations : comprendre, mesurer, maitriser

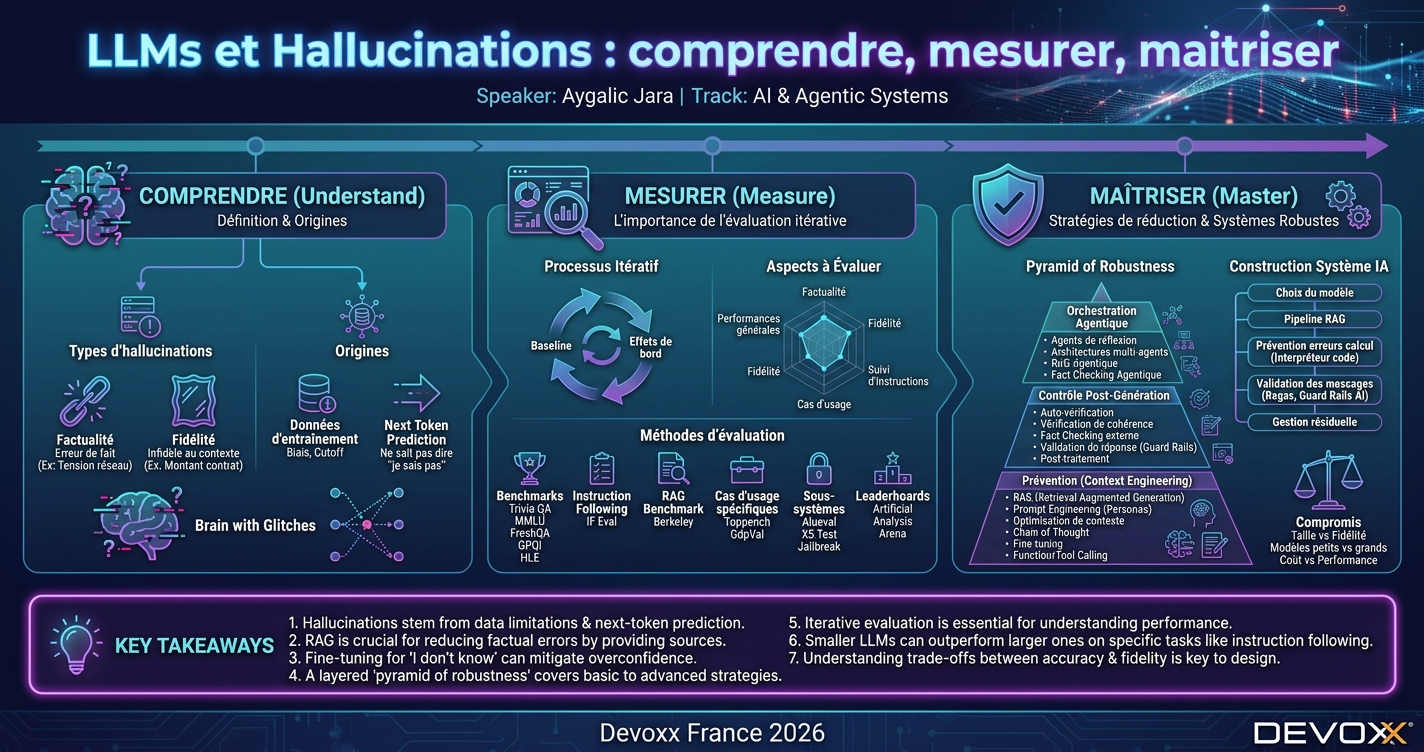

Ce talk analyse les hallucinations des LLMs : leurs causes, méthodes de détection et d’atténuation. Il présente des solutions comme le context engineering, les workflows agentiques, le RAG et certaines architectures, pour concevoir des IA plus fiables, adaptées aux usages critiques. Objectif : mieux comprendre et limiter ce phénomène.

talk.summaryAiDisclaimer

Aygalic JaraSCIAM

talkDetail.whenAndWhere

Thursday, April 23, 15:40-16:25

Maillot

Les LLMs bluffent souvent par leur assurance… même quand ils inventent. Ces hallucinations ternissent leur fiabilité et limitent leur usage dans des domaines critiques comme la santé ou la finance.

Mais d’où viennent-elles ? Comment les détecter, les évaluer, ou même les prévenir ?

Dans ce talk, nous explorerons leurs origines, les méthodes de détection et d’évaluation, puis les stratégies de réduction de leur fréquence et de leur impact. Nous verrons comment des approches issues du context engineering — comme les workflows agentiques ou le RAG — peuvent aider, ainsi que les bénéfices de certaines architectures pour des cas d’usage spécifiques.

L’objectif : démystifier ce phénomène et repartir avec les clés pour concevoir des systèmes d’IA plus fiables et robustes.

Mais d’où viennent-elles ? Comment les détecter, les évaluer, ou même les prévenir ?

Dans ce talk, nous explorerons leurs origines, les méthodes de détection et d’évaluation, puis les stratégies de réduction de leur fréquence et de leur impact. Nous verrons comment des approches issues du context engineering — comme les workflows agentiques ou le RAG — peuvent aider, ainsi que les bénéfices de certaines architectures pour des cas d’usage spécifiques.

L’objectif : démystifier ce phénomène et repartir avec les clés pour concevoir des systèmes d’IA plus fiables et robustes.

Aygalic Jara

Doctorant CIFRE (Paris Saclay × SCIAM), je mène des travaux sur les hallucinations des LLMs : détection automatique, protocoles de benchmarking et stratégies de mitigation. Ingénieur de formation (Centrale & Politecnico di Milano), j'enseigne également en systèmes d'exploitation et calcul scientifique à l'Université Paris-Saclay. Je me concentre sur les usages industriels fiables des modèles de langage